Update dell’algoritmo di Google per la pulizia della long tail

E' passato un po' di tempo da quando ho scritto questo articolo.

Il mondo del digital è sempre in evoluzione e potresti trovare delle informazioni non più aggiornate.

In questi giorni vi è stato un importante update nell'algoritmo di ranking di Google, che ha scombinato le logiche di diverse pagine dei risultati e che in molti hanno scambiato per l'arrivo di Google Panda.

Durante gli ultimi giorni questa novità ha destato clamore nella comunità SEO: Davide Pozzi nel suo blog con il post Google Panda 2.2 attivo anche in Italia avverte della novità, Enrico Altavilla la vede lunga dicendo che Panda non c'entra un fico secco e i webmaster del forum GT si scambiano le prime avvisaglie.

Anche altri esimi colleghi delle rete mi hanno contattato personalmente descrivendo in sostanza un pattern di siti web comuni colpiti dall'update.

Il mitico Piersante Paneghel per primo dal suo tweet tenta di dare una prima descrizione della struttura dei siti web colpiti:

...per ora mi pare che il pattern colpito sia: IF same-owner AND dupe-site THEN both-site drop traffic. No Panda

Caso dopo caso le caratteristiche della penalizzazione e del pattern dei siti colpiti sembra farsi un po' più chiara e potrebbe essere riassunta con le seguenti caratteristiche:

| Keyword interessate: | keyword di long tail, generalmente composte da 2 o più termini; |

| Cali riscontrati nella long tail: | chiaramente dipende dalla dimensione del sito, generalmente siti di grandi dimensioni hanno cali più importanti poichè è maggiore il numero di pagine colpite. Sono stati registrati cali dal 20 al 60%. |

| Caratteristiche dei contenuti del sito: | Tipicamente si tratta di siti web con contenuti duplicati o "abstract" di contenuti duplicati. L'origine dei contenuti duplicati può essere sia interna, ovvero se sono riprese informazioni dello stesso sito che esterna, ovvero la copia anche parziale i contenuti di altri siti. Le pagine "copiate" hanno sempre maggiore trust delle copie: in più di qualche caso sono notizie di quotidiani online ripresi da aggregatori. |

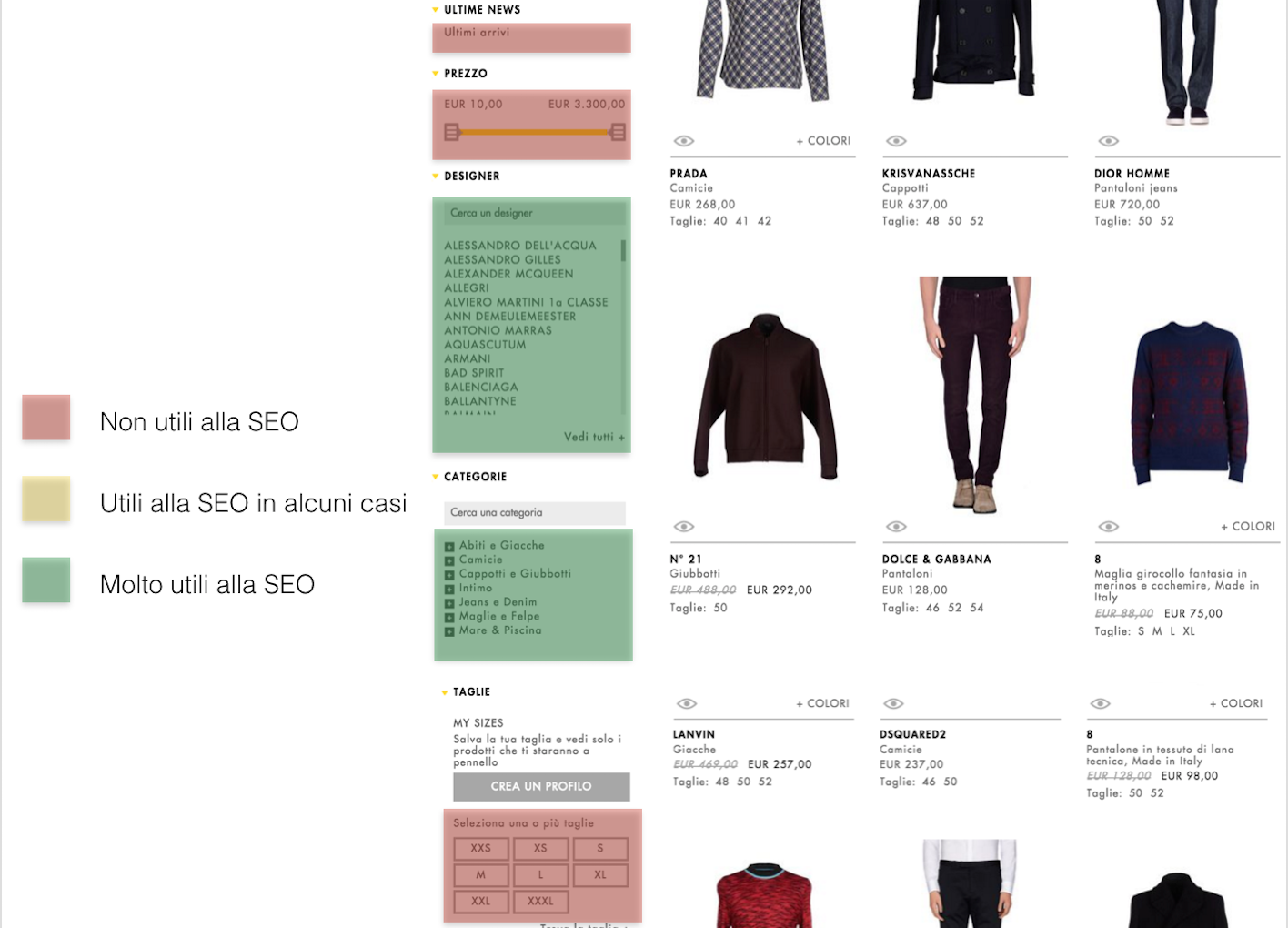

| Tipologia di pagine duplicate: | Sono state colpite sia pagine foglia, ad esempio un post di un blog copiato o schede prodotto duplicate di e-commerce, che pagine di navigazione, ad esempio delle pagine hub di accesso ad altre pagine. Le pagine sono sempre contraddistinte da una forte ottimizzazione SEO dei meta tag on page: con title, description ben mirate. |

| Presenza di AdSense | non sempre i siti colpiti fanno grande uso di Adv. |

Ci sono altri casi che avete riscontrato che "sbugiardiano" questa prima diagnosi? Che cosa ne pensate?

Sarà poi interessante capire come uscirne! :-P